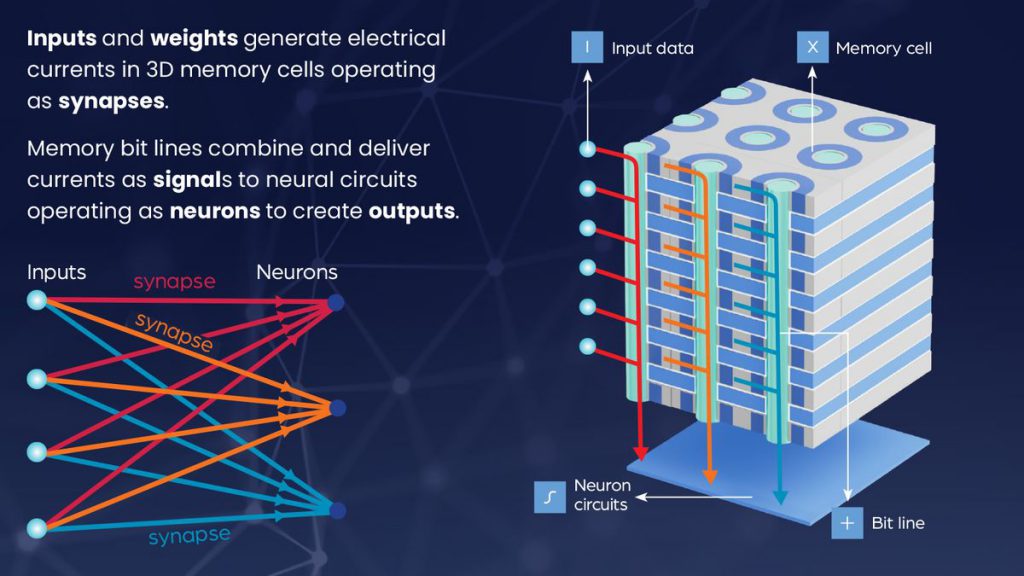

Компания NEO Semiconductor, специализирующаяся на 3D NAND и 3D DRAM, разработала технологию 3D X-AI для замены нынешних HBMS в графических ускорителях AI. Эта трёхмерная DRAM обладает встроенной системой искусственного интеллекта для обработки данных и генерации выходных результатов без необходимости проведения математических расчётов. Благодаря этому решению сокращается проблема узких мест в шине передачи данных при обмене большими объёмами информации между памятью и процессором, что повышает производительность и эффективность искусственного интеллекта.

Чип 3D X-AI основан на слое нейронных цепей, которые обрабатывают информацию, хранящуюся в 300 слоях памяти на одном кристалле. Согласно информации от NEO Semiconductor, эта трёхмерная память обеспечивает 100-кратное увеличение производительности благодаря 8000 нейронных схем, использующих искусственный интеллект для обработки данных. Также она имеет в восемь раз больше плотности памяти по сравнению с современными HBMS и, что более важно, снижает энергопотребление на 99% за счёт сокращения объёма данных, обрабатываемых мощными графическими процессорами.

Основатель и генеральный директор NEO Semiconductor Andy Hsu утверждает, что современные чипы искусственного интеллекта теряют производительность и мощность из-за неэффективной архитектуры и технологий.

Andy Hsu отметил, что в нынешней архитектуре чипа искусственного интеллекта данные хранятся в HBM, а вычисления выполняются графическим процессором. Из-за разделения процессов хранения и обработки данных шина данных становится узким местом, снижая производительность. Передача большого объёма данных через шину влечёт за собой падение производительности и высокое энергопотребление. Однако технология 3D X-AI позволяет осуществлять обработку с использованием искусственного интеллекта непосредственно в каждом чипе HBM. Это существенно сокращает объём данных, передаваемых между HBM и GPU, что повышает производительность и снижает энергопотребление.

Компания заявляет, что X-AI обладает ёмкостью 128 ГБ и способен поддерживать скорость обработки данных с использованием искусственного интеллекта на уровне 10 Тбит/с на каждую сторону. Соединение двенадцати сторон в одну упаковку HBM обеспечивает объём памяти свыше 1,5 ТБ и производительность обработки данных 120 ТБ/с.

Развитие искусственного интеллекта открывает новые горизонты для вычислительной техники, и многие компании занимаются разработкой технологий, которые ускорят обработку данных и увеличат пропускную способность связи. Поскольку мы создаём всё более быстрые и эффективные полупроводники, шина, связывающая компоненты, становится узким местом. Таким образом, эти технологии позволят всем компонентам работать вместе быстрее.

Например, несколько компаний, таких как Intel, Kioxia и TSMC, работают над оптической технологией, которая ускоряет обмен данными внутри материнской платы. Однако, если перенести часть обработки ИИ с графического процессора на HBM, NEO Semiconductor сможет снизить нагрузку на него, что сделает его гораздо эффективнее по сравнению с современными энергоёмкими ускорителями ИИ.

По материалам:

tomshardware